Kejutan dari Sebuah Jawaban Aneh

Suatu hari, saya bertanya kepada sebuah chatbot AI:

"Berapa 3 + 4 x 2?"

Ia menjawab: "3 + 4 = 7, lalu 7 x 2 = 14."

Jawaban itu salah secara matematika. Tapi kemudian ia membalas lagi,

"Maaf. Operasi matematika mengikuti aturan precedence. 4 x 2 = 8, lalu 3 + 8 = 11."

Saya tertegun. Bukan hanya karena ia membetulkan diri, tapi karena AI itu menjelaskan langkah demi langkah logikanya. Ini bukan sembarang output, ini jejak berpikir. Dan dunia menyebut teknik ini: Chain of Thought.

Latar Belakang: Saat AI Tak Lagi Sekadar Menjawab

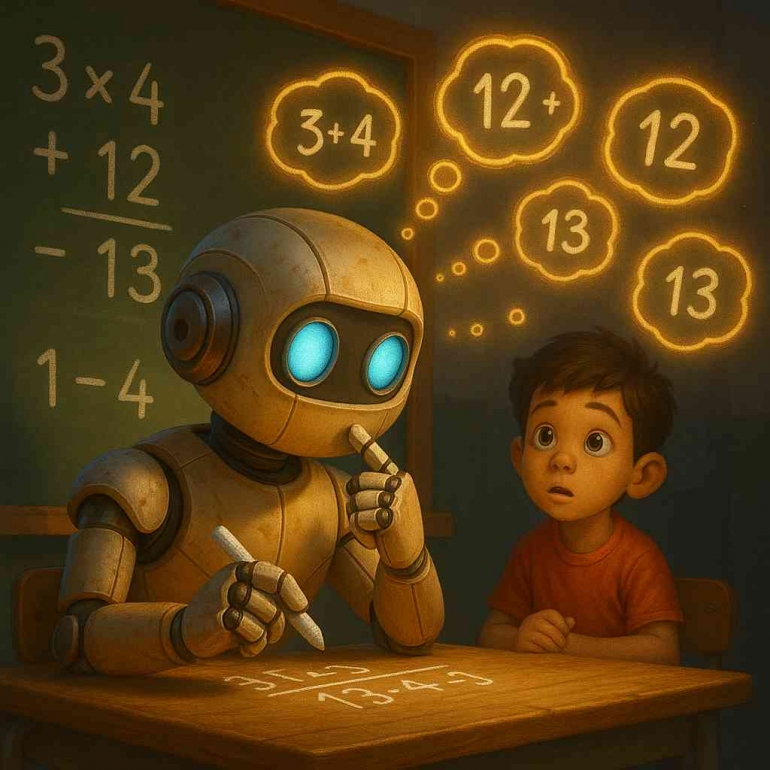

Selama bertahun-tahun, AI hanya dilatih untuk mencari jawaban akhir. Seperti murid yang hanya menghafal hasil tanpa tahu proses. Tapi kini, tren baru mengubah pendekatan itu: AI diajari untuk berpikir secara bertahap, seperti manusia mengurai masalah.

Inilah asal mula lahirnya konsep Chain of Thought (CoT) --- sebuah metode untuk melatih AI agar menampilkan jejak logika dalam menyelesaikan persoalan.

Analisis: Mengapa Ini Jadi Terobosan Besar

Bayangkan kita mengajar anak kecil cara memecahkan soal cerita. Kita tak langsung menyuruh mereka menjawab, tapi membimbing:

"Apa yang diketahui? Apa yang ditanya? Apa langkahnya?"

Itulah inti dari CoT. Alih-alih hanya menjawab "42", AI sekarang berkata:

"Langkah pertama adalah..., kemudian..., sehingga hasil akhirnya adalah..."

Ini membawa manfaat besar:

Mengurangi kesalahan logika

Memperjelas proses pengambilan keputusan

Lebih mudah diperiksa dan diaudit

Kesalahan Umum dalam Melatih AI Tanpa CoT

AI yang hanya dilatih dengan jawaban akhir cenderung:

Terlalu percaya diri dengan jawaban salah

Tidak bisa menunjukkan alasan di balik prediksi

Sulit digunakan untuk bidang kritis (medis, hukum, pendidikan)

Tanpa CoT, AI seperti murid yang "mencontek jawaban" tanpa tahu caranya.

Langkah Inovatif yang Diambil Peneliti

Google, OpenAI, dan Meta mulai menyuntikkan CoT ke dalam sistem mereka. Bahkan sekarang muncul varian baru seperti:

Self-Consistency: AI membuat banyak versi langkah, lalu menyimpulkan yang terbaik

Tree of Thought: AI mencoba banyak cabang ide dan menelusuri pohon kemungkinan

Ini menjadikan AI lebih seperti pemikir... bukan sekadar mesin jawab.

Fakta Ilmiah yang Menarik

Dalam publikasi Wei et al. (2022) oleh Google Research, CoT terbukti menaikkan akurasi jawaban AI dalam soal matematika kompleks hingga lebih dari 30%. Model yang tidak memiliki CoT hanya unggul pada soal-soal mudah.

Artinya, makin rumit tugasnya, makin dibutuhkan jejak logika --- seperti manusia.

Pertolongan Pertama Saat AI Bingung

Jika kamu pengguna AI dan merasa jawabannya aneh, coba ubah prompt-mu menjadi:

"Jelaskan langkah-langkah berpikirnya."

Atau:

"Tolong uraikan satu per satu dengan alasan."

AI yang mendukung CoT biasanya akan langsung mengaktifkan mode uraian logis.

Tips untuk Mencegah Penyalahgunaan CoT

Jangan anggap CoT sebagai jaminan kebenaran. AI bisa "ngebacot dengan logis tapi salah".

Gunakan CoT sebagai alat bantu berpikir, bukan pengganti nalar manusia.

Selalu lakukan verifikasi silang, terutama untuk keputusan penting.

Refleksi: Kita Juga Perlu Belajar dari AI

Sebagai manusia, sering kali kita malu menunjukkan proses berpikir. Kita ingin terlihat tahu segalanya, padahal justru belajar terjadi saat kita mengurai prosesnya.

AI kini belajar berpikir seperti manusia. Tapi ironisnya, kita justru ingin meniru AI yang serba cepat. Mungkin inilah waktunya kita belajar kembali: berpikir dengan jujur, lengkap, dan perlahan-lahan.

Karena kadang, rantai pikiran lebih berharga daripada sekadar hasil akhir.

Referensi:

Penelitian Google Research tentang Chain-of-Thought Prompting in Language Models

Eksperimen CoT oleh OpenAI dengan model GPT

Penjelasan umum dan tutorial penggunaan CoT oleh komunitas HuggingFace

.